我们应该担心人工智能的威胁吗?

平克从技术角度驳斥了AI威胁论,也简单提到了人类有能力约束AI带来的潜在威胁,但他并未就此问题展开详尽论述,而这正是比尔·盖茨所担心的问题:如何正当地使用AI?

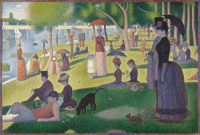

尽管新闻标题很惊悚,但客观数据显示,平均而言,全球各地的人们寿命更长了,生病更少了,吃得更好了,受教育更多了,接触的文化更丰富了,并且死于战争、谋杀或意外的可能性也越来越小了。然而,失望似乎是永恒的人性。即便悲观主义者不得不承认,对于越来越多的人来说,生活正变得越来越好,但他们还是随时都能拿出辩驳的理由。他们认为,我们正在狂欢中奔向末日,就好比一个人从天台跳下,在经过每层楼的时候说道:“目前感觉良好”;或者,就像玩俄罗斯轮盘赌,一直玩下去,结局一定是死亡;或者,我们将遭遇“黑天鹅”事件,虽说从统计分布来看,尚有多达四个标准差之远,事件发生的概率极小,但后果却十分严重。

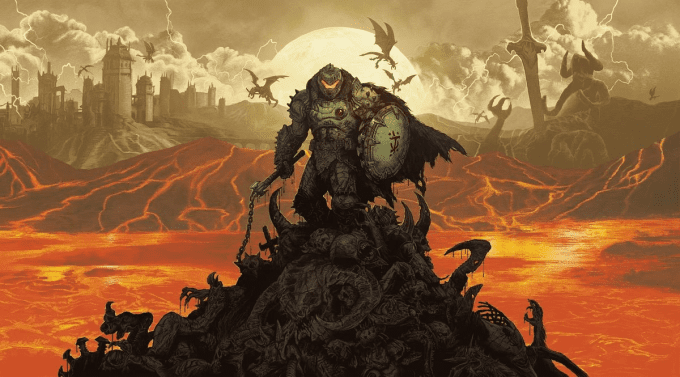

半个世纪以来,现代末日论有了四驾马车,分别是:人口过多、资源枯竭、环境污染和核武战争。现在,它们又多了一支新生的装甲部队:围困我们的纳米机器人、俘虏我们的机械人、将我们碾压成渣的人工智能,以及制造了计算机病毒、能在自己的卧室毁灭整个互联网的保加利亚年轻人(译注:1992年,一个名叫达克·埃文格的保加利亚人发明了一种“变换器”,利用这个工具可以制造出更难查杀的“变形”病毒。这个年轻人直言不讳,其目的就是要破坏人类的工作成果。)

捍卫类似这些马车的人是浪漫主义者和卢德主义者。然而,那些警告高科技十分危险的人,却往往是些科学家和技术专家。他们不惜发挥自己的聪明才智,竟然搞出这么多足以让世界迅速灭亡的东西出来。2003年,天体物理学家马丁·里斯(Martin Rees)出版了一本名叫《人类最后一小时》(Our Final Hour)的书,他在书中警告说,“人类正在亲手埋葬自己”,然后列举了人类让“整个宇宙的未来变得危险”的12种方式。比如,粒子对撞实验可能会产生黑洞,从而毁灭地球;或者,某个被压缩的奇异夸克会将所有的宇宙物质黏在一起,然后同归于尽。里斯在书中探讨了很多支持末日论的理由。该书在亚马逊网站的网页说明是,“浏览了这本书的读者还浏览了《全球性灾难的风险》(Global Catastrophic Risks)、《我们的最后发明:人工智能和人类时代的终结》(Our Final Invention: Artificial Intelligence and the End of the Human Era)、《人类终局:科学和宗教告诉我们什么是世界末日》(The End: What Science and Religion Tell Us About the Apocalypse)、《僵尸世界大战:僵尸战争口述史》(World War Z: An Oral History of the Zombie War)”。

技术慈善家已经为研究机构开具了支票,用于发现存亡威胁,找到将世界从这些威胁中拯救出来的方法,这些机构包括人类未来研究机构、生命未来研究机构、潜在风险研究中心、全球性灾难风险研究机构。

随着技术不断进步,我们该如何看待这些存亡威胁呢?没人敢肯定,灾难永远不会发生,我的这本书也不会做出这种保证。气候变化和核武战争是尤其严峻的全球性挑战。尽管还没能得到解决,但它们是有办法解决的。我们已经拿出了减少碳排放和去核化的长期路线图,这些问题正在解决过程之中。就每一美元所产生的GDP而言,全球的碳排放量已经减少了,而全球核武器的数量已经削减了85%。当然,为了避免可能的灾难,我们应该想尽各种办法让核武器的数量减为零。

不过,在这些现实的挑战面前,有一种挑战是是似而非的。有些科技评论家预测,我们将受到人工智能(AI)的奴役,这种危险有时又被称为“机器末日论”(Robopocalypse),“终结者”系列电影就经常呈现这种场景。有些聪明的家伙还很严肃地看待这种威胁(如果不是有点故弄玄虚的话)。埃隆·马斯克,他的公司生产人工智能的无人驾驶汽车,将AI称为“比核武器更危险”的事物。斯蒂芬·霍金,通过他的人工智能语音合成器警告说,AI可能会“招致人类的灭亡”。这些聪明的家伙都是人工智能和人类心智的顶尖专家,可他们从不会因为这些存亡威胁而失眠。

“机器末日论”建立在对智力概念的错误理解之上,而这种理解要归功于“伟大的存在之链”(the Great Chain of Being)(译注:是中世纪从古希腊哲学中衍生出来的一种观念,认为自然世界和人类社会是有等级和优劣秩序的)和尼采主义者的权力意志论,而与现代科学无关。这种误解把智力看成是一种威力无穷的灵丹妙药,每个生物体都或多或少地拥有它。

人类拥有的智力比动物更多,而未来的人工智能计算机或机器人(“一头AI”,用了一种新的量词)将比人类更聪明。既然我们人类已经用中等智力驯化或灭绝了低等智力的动物(既然技术先进的社会已经侵略或消灭了技术落后的原始社会),那么超级聪明的AI就会以同样的方式对待人类。既然“一头AI”的思考速度比我们快数百万倍,并且它还能用自己的超级智力通过不断迭代来提升自己的这种能力(这种情况有时被称为“嘭”,一本喜剧书中出现的拟声词)(译注:这里意指意识的突然觉醒)。这种自我迭代一旦开始,人类就无法阻止它了。

然而,这种情况就好比是在担心,既然喷气式飞机超越了老鹰的飞行能力,总有一天飞机会像老鹰一样盘旋于天空,捕获我们的牲畜。人们对AI的第一种误解在于,混淆了智力与动机——也即是对于欲望的感受、对于目标的追求、对于需求的满足——之间的区别。即便人类发明了超越了人类智力的机器人,为什么这些机器人一定想要奴役它们的主人,或者想要主宰这个世界呢?智力是一种运用新工具来实现目标的能力,但目标本身是与智力无关的:聪明与想要得到某个东西并不是一回事。只是很碰巧,在自然生态系统中,智人的智力是达尔文所谓自然选择的副产品,是一个天然的竞争过程。在生物的大脑中,智力与压制竞争对手、获取资源等目标产生了关联(其他动物在不同程度上也有这种关联)。然而,将灵长类动物大脑边缘的回路与智力本身的性质混淆起来,是明显错误的。人工智能系统是被人为设计出来的,而不是自然进化出来的,它的思维能力就像是阿尔·卡普(Al Capp)的连环漫画《莱尔·艾布纳》(Li’l Abner)中的漫画人物什穆(shmoos),他们是满脸雀斑的利他主义者,用自己无穷的智慧把自己烤熟,以饱人类的口福。复杂系统理论(译注:一种研究复杂系统和现象的科学研究领域,AI、股市、气象、生态都属于复杂系统)中没有任何定律认为,有智力的行为主体必定会成为残忍的征服者。

第二种误解是认为,智力是一种无限制的连续能力,是能够解决一切问题的全能的灵丹妙药,可以实现任何目标。这种误解让人们提出了一些毫无意义的问题,比如,什么时候AI可以“超越人类智力”?拥有上帝般全知全能的终极“通用人工智能”(AGI)会是什么样子?实际上,智力是一种很精巧的东西:比如,被设计或者被编码的软件模型、在不同领域追求不同目标的知识,等等。人类具有寻找食物、结交朋友、影响他人、吸引配偶、抚养小孩、全球旅行、从事其他人类爱好和消遣的能力。计算机程序也许能被设计用于完成某些人类才能完成的任务(比如,识别面孔),但却不能被设计用于干扰他人(比如,勾引对象),当然,它还可以被设计用于处理一些人类无法解决的问题(比如,模拟气象变化,或者处理数以百万计的会计账目)。

但问题不同,解决它们所需要的知识也不一样。不同于“拉普拉斯妖”(Laplace’s demon)——一种神秘的存在物,它知道宇宙中每个粒子的位置和速度,并将这些信息输入物理定律公式,计算出每样事物在未来任何时点的状态——真实生活中的认知主体必须要从混乱的客观世界,以及从某个时点参与某个领域活动的人们那里获取信息。对知识的理解并不违背摩尔定律:它是通过不断构建理论并接受现实检验,而不是通过速度越来越快的算法来实现的。消化互联网上的海量信息不足以让AI拥有全知能力:大数据仍然是有限的数据,而宇宙的知识却是无限的。

即便通用人工智能想要展现权力意志,没有人类的合作,它仍然只是无用的“缸中之脑”。

正是因为有了这些误解,最近的舆论宣传(AI会带来永久的威胁)让AI研究者颇感烦扰,这些宣传让观察家们误以为通用人工智能的出现近在眼前。就我所知,根本没有任何机构正在研究通用人工智能,这不仅仅是因为它的商业价值是不确定的,还因为这一概念在逻辑上就是自相矛盾的。当然,自2010年代以来,我们已经见证了AI能够驾驶汽车、标记图片、识别语音,见证了AI在《危险边缘》(Jeopardy!)(译注:美国智力竞赛电视节目)、围棋和阿塔里电脑游戏(Atari computer games)(译注:一类1980年代流行的电子游戏)中击败了人类。

然而,AI的这些进步不是来自于对智力机制的理解,而是来自于处理速度更快、能力更强的芯片和丰富的大数据,这些数据可以让计算机程序在数以百万计的案例中得到训练,并产生类似的新案例。每一个智力系统都是一个天才的白痴,几乎没有能力解决它无力解决的问题,并且也只能解决很小一部分它被设计出来用以解决的问题,比如,一个图像标记系统将一张即将坠毁的飞机照片识别成了“一架飞机停在柏油跑道上”;一个电子游戏娱乐系统对计分规则的细微变化感到困惑不解。虽然这些系统肯定会表现得越来越好,但仍然没有“嘭”出现的迹象。这些系统的演进方向既不是要去接管实验室,也不是要去奴役它们的设计人员。

即便通用人工智能想要展现权力意志,没有人类的合作,它仍然只是无用的“缸中之脑”。计算机科学家拉姆齐·纳姆(Ramez Naam)驳斥了甚嚣尘上的AI意识觉醒论、技术奇点论和几何指数的自我迭代论:

想象你是一个运行在某种微处理器上(或许,由数百万计的微处理器组成)的AI,拥有超级智能。突然,你想要设计一个更快、更强大的处理器,用于你的运行。现在……靠!你必须要生产制造这种处理器。而生产工厂的运转需要巨大的能量,它需要从周围环境中获取原材料,需要严格控制内部环境,保证气闸、过滤器以及其他各种特殊设备正常运转。获取材料、运输、加工、建造厂房、修建动力机房、测试、生产,所有这些工作都要花费时间和能量。现实世界是你螺旋式自我迭代的最大障碍。

现实世界不会为很多数字技术灾难的发生提供条件。当《2001太空漫游》中的人工智能HAL发疯时,戴夫可以用螺丝刀把它废掉,让它可怜兮兮地对着自己唱儿歌:《双人自行车》(A Bicycle Built for Two)。当然,总是有人认为“末日机器”一定会出现,这种机器心狠手辣、无所不能、永久开启,并且可以防止人类干预。应对这种威胁的办法很简单:不去制造它!

正当人们意识到把机器人想得太邪恶似乎是在庸人自扰的时候,人类卫道士又发现了一种新的数字技术灾难。这种想象不是建立在弗兰肯斯坦或希伯来传说中的Golem(译注:有行动力、无思考力的假人)的故事之上的,而是建立在魔瓶里的妖怪和米达斯王的故事之上的。妖怪允许人们许三个愿,但第三个愿望的内容是阻止前两个愿望实现,而米达斯则后悔自己将他触碰到的每样事物都变成了黄金,包括他的食物和家人。这种危险有时被称为“价值取向问题”(the Value Alignment Problem),也就是说,我们可能会给AI一个目标,然后绝望地呆在一旁,看着它按照自己的理解去执行目标,并最终损害人类的利益。如果我们让AI去维持一个水库的水位,它就有可能泄闸,把一个城镇给淹了,而不管人类的死活。如果我们让AI生产回形针,它就有可能把所有能接触到的宇宙物质都制造成回形针,包括我们的私人物品和身体。如果我们让它将人类的幸福最大化,它就有可能用多巴胺营养液对我们进行静脉注射;或者,用计算机连接我们的大脑,让我们坐在化学缸中,快乐致死;又或者,如果它经过训练,通过反复观看笑脸图片理解了幸福的概念,它就会用几十亿张纳米大小的笑脸图片塞满整个银河系。

这些段子可不是我编造的。有些人的确认为,这些场景很好地描绘了先进的人工智能对人类所产生的威胁。所幸的是,这些场景是自败的。它们取决于如下一些假设:1)人类太聪明,居然能设计出全知全能的AI,但又太愚蠢,居然在没能搞懂AI运作机制的情况下让它控制了全世界;2)AI太聪明,以至于它知道如何改变化学元素,重新连接大脑,但又愚蠢到因为犯下一些低级的理解错误,造成了巨大破坏。要让AI具备解决这种矛盾的能力,工程师可能心想给AI添加插件就行了,并为之前忘了做这项工作而后悔不迭,但添加插件是无济于事的,因为这个问题涉及到智力。同样,要想让AI具备理解语言使用者在特定语境下的意图,靠添加插件也是不管用的。机器人所能做的,只能是在类似于《糊涂侦探》(Get Smart)这样的喜剧片中,响应“抓起服务员”的命令,将大堂经理举过头顶;或者通过拔出手枪、开枪射击去“灭掉灯光”。

当我们抛开意识觉醒、技术自负、即时全知、控制宇宙每个粒子之类的幻想时,人工智能就跟其他任何技术无异。它的发展是渐进的,其目的是被用于满足人类的各种需求。在投入执行任务之前,它会经受严格测试,并总是会在效能和安全之间取得平衡。正如AI专家斯图尔特·罗素(Stuart Russell)所说:“没有任何人类工程师会说‘修建不会垮的大桥’,他们只会说‘修建大桥’。”同理,他认为,只有益处没有危害的AI才是真正的AI。

当然,人工智能还是提出了更为日常性的挑战:我们该如何帮助那些工作被机器所取代了的人群?不过,这类工作还不会很快就消失。NASA在1965年发布的报告中所提出的洞见至今仍是有效的:“人类是一种能量消耗最低、重量仅有150磅、思维非线性的通用计算机,哪怕是技能不熟练的工人也能生产出这种机器。” 驾驶汽车是一种比卸下洗碗机、跑腿打杂、更换尿布以及此刻撰写文章更容易的工程技术问题,至今我们也还没准许自动驾驶汽车行使在城市道路上。也许,机器人军团最终可以在发展中国家为婴儿接种疫苗、修建学校,或者在我们这样的国家修建基础设施,照顾老人,但要等到这一天,还有很多工作要做。人类的才智既可以被用于设计软件和机器人,也可以被用于设计政府和私营部门政策,好让失业的人有工作可做。

本文改编自斯蒂芬·平克新书《Enlightenment Now: The Case for Reason, Science, Humanism, and Progress》,首发于《Popular Science》2018年春季智能专刊(the Spring 2018 Intelligence issue )。

翻译:王培;编辑:EON

加拿大–美国实验心理学家、认知科学家和科普作家,哈佛大学心理学教授。著有《语言本能》(The Language Instinct)、《心智探奇》(How the Mind Works)、《思想本质》(The Stuff of Thought)、《白板》(The Blank Slate)等。他的书籍已经赢得了无数奖项而且是《纽约时报》的畅销书。

AI对人类的威胁并不是 AI会奴役人类,而是AI被少数掌权的人利用来 压制奴役大多数普通百姓。

AI 的运行软件是人类开发编译的,计算能力(搜索能力),恶劣环境奈受力,承重施重能力比人类强,干活比人类准快。危险的是失控的机器人,比如机器人是杀伤性武器,软件出错,机器人乱杀人就很难控制,但是设计人员肯定会设置不同的控制方案的;还有就是杀伤性机器人被不法分子控制利用,危害力挺大的。

马斯克当时预计,未来机器人做任何事都将比任何人做得好,“肯定会颠覆就业”市场,人工智能技术不但威胁人类工作,甚至还可能引发战争。他甚至断言:“人工智能是人类文明存在的根本性风险。”

据香港《文汇报》1月20日报道,英国著名物理学家霍金预测,随着科技的发展,人类正面临一系列可导致自身灭绝的风险,包括核战争、全球暖化及转基因病毒等。

https://m.weibo.cn/2485108114/4136985511670002

霍金认为人类最终能移居其他星球,因此即使发生灾难,也能生存下去。不过他警告,未来数百年人类仍无法建立自给自足的外层空间栖息地,在此期间必须小心防范科技带来的风险。

https://m.weibo.cn/2485108114/4172847443970093

2017年11月9日的《自然》评论版,《针对脑神经科技和人工智能的4个伦理道德的重要事项》:此科技可能加剧社会不平等,给企业、黑客、政府或者其他任何人带来剥削和操控大众的新手段。这或将深远地影响人类的几个核心特征:私密的精神生活,个体能动性,以及对于人类是被身体束缚的实体的理解。